Python爬虫(六)–Scrapy框架学习

本文希望达到以下目标:

- 简要介绍Scarpy

- 阅读官网入门文档并实现文档中的范例

- 使用Scarpy优豆瓣爬虫的抓取

- 制定下一步学习目标

初学

Scrapy, 如有翻译不当, 或者代码错误, 请指出, 非常感谢

1. Scrapy简介

Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架。 可以应用在包括数据挖掘,信息处理或存储历史数据等一系列的程序中。

其最初是为了页面抓取 (更确切来说, 网络抓取 )所设计的, 也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services ) 或者通用的网络爬虫。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试

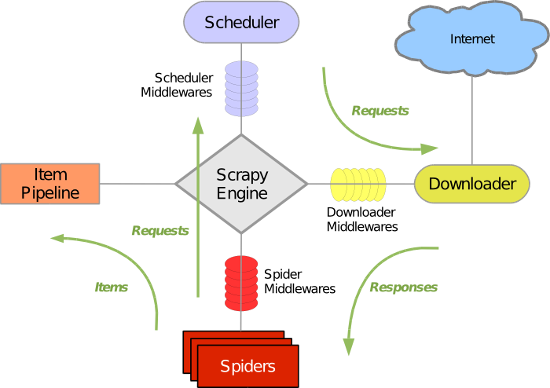

Scrapy 使用了 Twisted异步网络库来处理网络通讯。整体架构大致如下

Scrapy

Scrapy主要包括了以下组件:

- 引擎(Scrapy): 用来处理整个系统的数据流处理, 触发事务(框架核心)

- 调度器(Scheduler): 用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址

- 下载器(Downloader): 用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的)

- 爬虫(Spiders): 爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面

- 项目管道(Pipeline): 负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。

- 下载器中间件(Downloader Middlewares): 位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。

- 爬虫中间件(Spider Middlewares): 介于Scrapy引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。

- 调度中间件(Scheduler Middewares): 介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy运行流程大概如下:

- 首先,引擎从调度器中取出一个链接(URL)用于接下来的抓取

- 引擎把URL封装成一个请求(Request)传给下载器,下载器把资源下载下来,并封装成应答包(Response)

- 然后,爬虫解析Response

- 若是解析出实体(Item),则交给实体管道进行进一步的处理。

- 若是解析出的是链接(URL),则把URL交给Scheduler等待抓取

2. 安装Scrapy

使用以下命令:

sudo pip install virtualenv #安装虚拟环境工具

virtualenv ENV #创建一个虚拟环境目录

source ./ENV/bin/active #激活虚拟环境

pip install Scrapy

#验证是否安装成功

pip list

#输出如下

cffi (0.8.6)

cryptography (0.6.1)

cssselect (0.9.1)

lxml (3.4.1)

pip (1.5.6)

pycparser (2.10)

pyOpenSSL (0.14)

queuelib (1.2.2)

Scrapy (0.24.4)

setuptools (3.6)

six (1.8.0)

Twisted (14.0.2)

w3lib (1.10.0)

wsgiref (0.1.2)

zope.interface (4.1.1)更多虚拟环境的操作可以查看我的博文

3. Scrapy Tutorial

在抓取之前, 你需要新建一个Scrapy工程. 进入一个你想用来保存代码的目录,然后执行:

$ scrapy startproject tutorial这个命令会在当前目录下创建一个新目录 tutorial, 它的结构如下:

.

├── scrapy.cfg

└── tutorial

├── __init__.py

├── items.py

├── pipelines.py

├── settings.py

└── spiders

└── __init__.py这些文件主要是:

- scrapy.cfg: 项目配置文件

- tutorial/: 项目python模块, 之后您将在此加入代码

- tutorial/items.py: 项目items文件

- tutorial/pipelines.py: 项目管道文件

- tutorial/settings.py: 项目配置文件

- tutorial/spiders: 放置spider的目录

3.1. 定义Item

Items是将要装载抓取的数据的容器,它工作方式像 python 里面的字典,但它提供更多的保护,比如对未定义的字段填充以防止拼写错误

通过创建scrapy.Item类, 并且定义类型为 scrapy.Field 的类属性来声明一个Item.

我们通过将需要的item模型化,来控制从 dmoz.org 获得的站点数据,比如我们要获得站点的名字,url 和网站描述,我们定义这三种属性的域。在 tutorial 目录下的 items.py 文件编辑

from scrapy.item import Item, Field

class DmozItem(Item):

# define the fields for your item here like:

name = Field()

description = Field()

url = Field()3.2. 编写Spider

Spider 是用户编写的类, 用于从一个域(或域组)中抓取信息, 定义了用于下载的URL的初步列表, 如何跟踪链接,以及如何来解析这些网页的内容用于提取items。

要建立一个 Spider,继承 scrapy.Spider 基类,并确定三个主要的、强制的属性:

- name:爬虫的识别名,它必须是唯一的,在不同的爬虫中你必须定义不同的名字.

- start_urls:包含了Spider在启动时进行爬取的url列表。因此,第一个被获取到的页面将是其中之一。后续的URL则从初始的URL获取到的数据中提取。我们可以利用正则表达式定义和过滤需要进行跟进的链接。

- parse():是spider的一个方法。被调用时,每个初始URL完成下载后生成的 Response 对象将会作为唯一的参数传递给该函数。该方法负责解析返回的数据(response data),提取数据(生成item)以及生成需要进一步处理的URL的 Request 对象。

这个方法负责解析返回的数据、匹配抓取的数据(解析为 item )并跟踪更多的 URL。

在 /tutorial/tutorial/spiders 目录下创建 dmoz_spider.py

import scrapy

class DmozSpider(scrapy.Spider):

name = \"dmoz\"

allowed_domains = [\"dmoz.org\"]

start_urls = [

\"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/\",

\"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/\"

]

def parse(self, response):

filename = response.url.split(\"/\")[-2]

with open(filename, \'wb\') as f:

f.write(response.body)3.3. 爬取

当前项目结构

├── scrapy.cfg

└── tutorial

├── __init__.py

├── items.py

├── pipelines.py

├── settings.py

└── spiders

├── __init__.py

└── dmoz_spider.py到项目根目录, 然后运行命令:

$ scrapy crawl dmoz运行结果:

2014-12-15 09:30:59+0800 [scrapy] INFO: Scrapy 0.24.4 started (bot: tutorial)

2014-12-15 09:30:59+0800 [scrapy] INFO: Optional features available: ssl, http11

2014-12-15 09:30:59+0800 [scrapy] INFO: Overridden settings: {\'NEWSPIDER_MODULE\': \'tutorial.spiders\', \'SPIDER_MODULES\': [\'tutorial.spiders\'], \'BOT_NAME\': \'tutorial\'}

2014-12-15 09:30:59+0800 [scrapy] INFO: Enabled extensions: LogStats, TelnetConsole, CloseSpider, WebService, CoreStats, SpiderState

2014-12-15 09:30:59+0800 [scrapy] INFO: Enabled downloader middlewares: HttpAuthMiddleware, DownloadTimeoutMiddleware, UserAgentMiddleware, RetryMiddleware, DefaultHeadersMiddleware, MetaRefreshMiddleware, HttpCompressionMiddleware, RedirectMiddleware, CookiesMiddleware, ChunkedTransferMiddleware, DownloaderStats

2014-12-15 09:30:59+0800 [scrapy] INFO: Enabled spider middlewares: HttpErrorMiddleware, OffsiteMiddleware, RefererMiddleware, UrlLengthMiddleware, DepthMiddleware

2014-12-15 09:30:59+0800 [scrapy] INFO: Enabled item pipelines:

2014-12-15 09:30:59+0800 [dmoz] INFO: Spider opened

2014-12-15 09:30:59+0800 [dmoz] INFO: Crawled 0 pages (at 0 pages/min), scraped 0 items (at 0 items/min)

2014-12-15 09:30:59+0800 [scrapy] DEBUG: Telnet console listening on 127.0.0.1:6023

2014-12-15 09:30:59+0800 [scrapy] DEBUG: Web service listening on 127.0.0.1:6080

2014-12-15 09:31:00+0800 [dmoz] DEBUG: Crawled (200) 3.4. 提取Items

3.4.1. 介绍Selector

从网页中提取数据有很多方法。Scrapy使用了一种基于 XPath 或者 CSS 表达式机制: Scrapy Selectors

出XPath表达式的例子及对应的含义:

-

/html/head/title: 选择HTML文档中标签内的</code> 元素</li> <li> <code>/html/head/title/text()</code>: 选择 <code><title></code> 元素内的文本</li> <li> <code>//td</code>: 选择所有的 <code><td></code> 元素</li> <li> <code>//div[@class=\"mine\"]</code>: 选择所有具有<code>class=\"mine\"</code> 属性的 div 元素</li> </ul> <blockquote> <p>等多强大的功能使用可以查看XPath tutorial</p> </blockquote> <p>为了方便使用 XPaths,Scrapy 提供 Selector 类, 有四种方法 :</p> <ul> <li>xpath():返回selectors列表, 每一个selector表示一个xpath参数表达式选择的节点.</li> <li>css() : 返回selectors列表, 每一个selector表示CSS参数表达式选择的节点</li> <li>extract():返回一个unicode字符串,该字符串为XPath选择器返回的数据</li> <li>re(): 返回unicode字符串列表,字符串作为参数由正则表达式提取出来</li> </ul> <h3 id="3-4-2-%e5%8f%96%e5%87%ba%e6%95%b0%e6%8d%ae">3.4.2. 取出数据</h3> <p>首先使用谷歌浏览器开发者工具, 查看网站源码, 来看自己需要取出的数据形式(这种方法比较麻烦), 更简单的方法是直接对感兴趣的东西右键<code>审查元素</code>, 可以直接查看网站源码</p> <p>在查看网站源码后, 网站信息在第二个<code><ul></code>内</p> <pre><code><ul class=\"directory-url\" style=\"margin-left:0;\"> <li><a href=\"http://www.pearsonhighered.com/educator/academic/product/0,,0130260363,00%2Ben-USS_01DBC.html\" class=\"listinglink\">Core Python Programming</a> - By Wesley J. Chun; Prentice Hall PTR, 2001, ISBN 0130260363. For experienced developers to improve extant skills; professional level examples. Starts by introducing syntax, objects, error handling, functions, classes, built-ins. [Prentice Hall] <div class=\"flag\"><a href=\"/public/flag?cat=Computers%2FProgramming%2FLanguages%2FPython%2FBooks&url=http%3A%2F%2Fwww.pearsonhighered.com%2Feducator%2Facademic%2Fproduct%2F0%2C%2C0130260363%2C00%252Ben-USS_01DBC.html\"><img src=\"/img/flag.png\" alt=\"[!]\" title=\"report an issue with this listing\"></a></div> </li> ...省略部分... </ul></code></pre> <p>那么就可以通过一下方式进行提取数据</p> <pre><code>#通过如下命令选择每个在网站中的 <li> 元素: sel.xpath(\'//ul/li\') #网站描述: sel.xpath(\'//ul/li/text()\').extract() #网站标题: sel.xpath(\'//ul/li/a/text()\').extract() #网站链接: sel.xpath(\'//ul/li/a/@href\').extract() #如前所述,每个 xpath() 调用返回一个 selectors 列表,所以我们可以结合 xpath() 去挖掘更深的节点。我们将会用到这些特性,所以: for sel in response.xpath(\'//ul/li\') title = sel.xpath(\'a/text()\').extract() link = sel.xpath(\'a/@href\').extract() desc = sel.xpath(\'text()\').extract() print title, link, desc</code></pre> <p>在已有的爬虫文件中修改代码</p> <pre><code>import scrapy class DmozSpider(scrapy.Spider): name = \"dmoz\" allowed_domains = [\"dmoz.org\"] start_urls = [ \"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/\", \"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/\" ] def parse(self, response): for sel in response.xpath(\'//ul/li\'): title = sel.xpath(\'a/text()\').extract() link = sel.xpath(\'a/@href\').extract() desc = sel.xpath(\'text()\').extract() print title, link, desc</code></pre> <h3 id="3-4-3-%e4%bd%bf%e7%94%a8item">3.4.3. 使用item</h3> <p><code>Item</code>对象是自定义的python字典,可以使用标准的字典语法来获取到其每个字段的值(字段即是我们之前用Field赋值的属性)</p> <pre><code>>>> item = DmozItem() >>> item[\'title\'] = \'Example title\' >>> item[\'title\'] \'Example title\'</code></pre> <p>一般来说,Spider将会将爬取到的数据以 Item 对象返回, 最后修改爬虫类,使用 Item 来保存数据,代码如下</p> <pre><code>from scrapy.spider import Spider from scrapy.selector import Selector from tutorial.items import DmozItem class DmozSpider(Spider): name = \"dmoz\" allowed_domains = [\"dmoz.org\"] start_urls = [ \"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/\", \"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/\", ] def parse(self, response): sel = Selector(response) sites = sel.xpath(\'//ul[@class=\"directory-url\"]/li\') items = [] for site in sites: item = DmozItem() item[\'name\'] = site.xpath(\'a/text()\').extract() item[\'url\'] = site.xpath(\'a/@href\').extract() item[\'description\'] = site.xpath(\'text()\').re(\'-\\s[^\\n]*\\\\r\') items.append(item) return items</code></pre> <h2 id="3-5-%e4%bd%bf%e7%94%a8item-pipeline">3.5. 使用Item Pipeline</h2> <p>当Item在Spider中被收集之后,它将会被传递到Item Pipeline,一些组件会按照一定的顺序执行对Item的处理。<br />每个item pipeline组件(有时称之为<code>ItemPipeline</code>)是实现了简单方法的Python类。他们接收到Item并通过它执行一些行为,同时也决定此Item是否继续通过pipeline,或是被丢弃而不再进行处理。<br />以下是item pipeline的一些典型应用:</p> <ul> <li>清理HTML数据</li> <li>验证爬取的数据(检查item包含某些字段)</li> <li>查重(并丢弃)</li> <li>将爬取结果保存,如保存到数据库、XML、JSON等文件中</li> </ul> <blockquote> <p> 编写你自己的item pipeline很简单,每个item pipeline组件是一个独立的Python类,同时必须实现以下方法:</p> </blockquote> <pre><code>process_item(item, spider) #每个item pipeline组件都需要调用该方法,这个方法必须返回一个 Item (或任何继承类)对象,或是抛出 DropItem异常,被丢弃的item将不会被之后的pipeline组件所处理。 #参数: item: 由 parse 方法返回的 Item 对象(Item对象) spider: 抓取到这个 Item 对象对应的爬虫对象(Spider对象) open_spider(spider) #当spider被开启时,这个方法被调用。 #参数: spider : (Spider object) – 被开启的spider close_spider(spider) #当spider被关闭时,这个方法被调用,可以再爬虫关闭后进行相应的数据处理。 #参数: spider : (Spider object) – 被关闭的spider</code></pre> <blockquote> <p>为JSON文件编写一个items</p> </blockquote> <pre><code>from scrapy.exceptions import DropItem class TutorialPipeline(object): # put all words in lowercase words_to_filter = [\'politics\', \'religion\'] def process_item(self, item, spider): for word in self.words_to_filter: if word in unicode(item[\'description\']).lower(): raise DropItem(\"Contains forbidden word: %s\" % word) else: return item</code></pre> <p>在 settings.py 中设置<code>ITEM_PIPELINES</code>激活item pipeline,其默认为[]</p> <pre><code>ITEM_PIPELINES = {\'tutorial.pipelines.FilterWordsPipeline\': 1}</code></pre> <h2 id="3-6-%e5%ad%98%e5%82%a8%e6%95%b0%e6%8d%ae">3.6. 存储数据</h2> <p>使用下面的命令存储为<code>json</code>文件格式</p> <pre><code>scrapy crawl dmoz -o items.json</code></pre> <h1 id="4-scarpy%e4%bc%98%e5%8c%96%e8%b1%86%e7%93%a3%e7%88%ac%e8%99%ab%e7%9a%84%e6%8a%93%e5%8f%96">4. Scarpy优化豆瓣爬虫的抓取</h1> <hr /> <p>主要针对之间写过的豆瓣爬虫进行重构:</p> <ul> <li>Python网络爬虫(二)–豆瓣抓站小计</li> <li>豆瓣抓站重构第二版</li> </ul> <p>豆瓣有反爬虫机制, 只成功了一次后, 就被<code>baned</code>后显示403了, 下面说一下爬虫结构</p> <p>完整的豆瓣爬虫代码链接</p> <h2 id="4-1-item">4.1. Item</h2> <pre><code>from scrapy.item import Item, Field class DoubanItem(Item): # define the fields for your item here like: # name = scrapy.Field() name = Field() #电影名称 description = Field() #电影描述 url = Field() #抓取的url</code></pre> <h2 id="4-2-spider%e4%b8%bb%e7%a8%8b%e5%ba%8f">4.2. Spider主程序</h2> <pre><code>#!/usr/bin/env python # -*- coding:utf-8 -*- \"\"\" 一个简单的Python 爬虫, 用于抓取豆瓣电影Top前250的电影的名称描述等 Anthor: Andrew Liu Version: 0.0.3 Date: 2014-12-17 Language: Python2.7.8 Editor: Sublime Text2 Operate: 具体操作请看README.md介绍 \"\"\" from scrapy.contrib.spiders import CrawlSpider, Rule from scrapy.selector import Selector from douban.items import DoubanItem from scrapy.contrib.linkextractors.sgml import SgmlLinkExtractor class DoubanSpider(CrawlSpider) : name = \"douban\" allowed_domains = [\"movie.douban.com\"] start_urls = [\"http://movie.douban.com/top250\"] rules = ( #将所有符合正则表达式的url加入到抓取列表中 Rule(SgmlLinkExtractor(allow = (r\'http://movie\\.douban\\.com/top250\\?start=\\d+&filter=&type=\',))), #将所有符合正则表达式的url请求后下载网页代码, 形成response后调用自定义回调函数 Rule(SgmlLinkExtractor(allow = (r\'http://movie\\.douban\\.com/subject/\\d+\', )), callback = \'parse_page\', follow = True), ) def parse_page(self, response) : sel = Selector(response) item = DoubanItem() item[\'name\'] = sel.xpath(\'//h1/span[@property=\"v:itemreviewed\"]/text()\').extract() item[\'description\'] = sel.xpath(\'//div/span[@property=\"v:summary\"]/text()\').extract() item[\'url\'] = response.url return item</code></pre> <h2 id="4-3-%e6%9c%aa%e6%9d%a5%e8%a6%81%e8%a7%a3%e5%86%b3%e7%9a%84%e9%97%ae%e9%a2%98">4.3. 未来要解决的问题</h2> <ul> <li>头部伪装</li> <li>表单提交</li> <li>编码转换</li> </ul> <blockquote> <p>豆瓣抓了一会儿, 还没等我兴奋就被禁掉了</p> </blockquote> <p>ban</p> <pre><code>... 2014-12-17 22:02:17+0800 [douban] DEBUG: Crawled (403) <GET http://www.douban.com/misc/sorry?original-url=http%3A%2F%2Fmovie.douban.com%2Fsubject%2F2209573%2F%3Ffrom%3Dsubject-page> (referer: http://movie.douban.com/subject/1849031/) 2014-12-17 22:02:17+0800 [douban] DEBUG: Ignoring response <403 http://www.douban.com/misc/sorry?original-url=http%3A%2F%2Fmovie.douban.com%2Fsubject%2F2209573%2F%3Ffrom%3Dsubject-page>: HTTP status code is not handled or not allowed 2014-12-17 22:02:17+0800 [douban] DEBUG: Crawled (403) <GET http://www.douban.com/misc/sorry?original-url=http%3A%2F%2Fmovie.douban.com%2Fsubject%2F1849031%2Fcomments%3Fsort%3Dtime> (referer: http://movie.douban.com/subject/1849031/) ...</code></pre> <h1 id="5-%e5%8f%82%e8%80%83%e9%93%be%e6%8e%a5">5. 参考链接</h1> <hr /> <ul> <li>Basic concepts</li> <li> What else? section in Scrapy at a glance </li> <li>Item Pipeline</li> <li>Scrapy Tutorial</li> <li>BeautifulSoup</li> <li>mechanize</li> <li>scrapy</li> <li>Selectors documentation</li> <li>scrapy 中文教程(爬cnbeta实例)</li> <li>dmoz</li> </ul> <!--end::Text--> </div> <!--end::Description--> <div class="mt-5"> <!--关键词搜索--> </div> <div class="mt-5"> <p class="fc-show-prev-next"> <strong>上一篇:</strong><a href="/program/8365.html">Django Model 定义语法</a><br> </p> <p class="fc-show-prev-next"> <strong>下一篇:</strong><a href="/program/8368.html">Python关键字yield的解释(stackoverflow)</a> </p> </div> <!--begin::Block--> <div class="d-flex flex-stack mb-2 mt-10"> <!--begin::Title--> <h3 class="text-dark fs-5 fw-bold text-gray-800">相关内容</h3> <!--end::Title--> </div> <div class="separator separator-dashed mb-9"></div> <!--end::Block--> <div class="row g-10"> </div> </div> <!--end::Table widget 14--> </div> <!--end::Col--> <!--begin::Col--> <div class="col-xl-4 mt-0"> <!--begin::Chart Widget 35--> <div class="card card-flush h-md-100"> <!--begin::Header--> <div class="card-header pt-5 "> <!--begin::Title--> <h3 class="card-title align-items-start flex-column"> <!--begin::Statistics--> <div class="d-flex align-items-center mb-2"> <!--begin::Currency--> <span class="fs-5 fw-bold text-gray-800 ">热门资讯</span> <!--end::Currency--> </div> <!--end::Statistics--> </h3> <!--end::Title--> </div> <!--end::Header--> <!--begin::Body--> <div class="card-body pt-3"> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/39278.html" class="text-dark fw-bold text-hover-primary fs-6">500 行 Python 代码...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">语法分析器描述了一个句子的语法结构,用来帮助其他的应用进行推理。自然语言引入了很多意外的歧义,以我们...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/831667.html" class="text-dark fw-bold text-hover-primary fs-6">定时清理删除C:\Progra...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">C:\Program Files (x86)下面很多scoped_dir开头的文件夹 写个批处理 定...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/3333.html" class="text-dark fw-bold text-hover-primary fs-6">65536是2的几次方 计算2...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">65536是2的16次方:65536=2⁶ 65536是256的2次方:65536=256 6553...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/4386.html" class="text-dark fw-bold text-hover-primary fs-6">Mobi、epub格式电子书如...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">在wps里全局设置里有一个文件关联,打开,勾选电子书文件选项就可以了。</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/uploadfile/202403/9fc6c8bf38a85fb.png#没有设置高宽参数,将以原图输出')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/831666.html" class="text-dark fw-bold text-hover-primary fs-6">scoped_dir32_70...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">一台虚拟机C盘总是莫名奇妙的空间用完,导致很多软件没法再运行。经过仔细检查发现是C:\Program...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/831649.html" class="text-dark fw-bold text-hover-primary fs-6"> pycparser 是一个用...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">`pycparser` 是一个用 Python 编写的 C 语言解析器。它可以用来解析 C 代码并构...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/783.html" class="text-dark fw-bold text-hover-primary fs-6">小程序支付时提示:appid和...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">[Q]小程序支付时提示:appid和mch_id不匹配 [A]小程序和微信支付没有进行关联,访问“小...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/7319.html" class="text-dark fw-bold text-hover-primary fs-6">Prometheus+Graf...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">一,Prometheus概述 1,什么是Prometheus?Prometheus是最初在Sound...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/41773.html" class="text-dark fw-bold text-hover-primary fs-6">python绘图库Matplo...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">本文简单介绍了Python绘图库Matplotlib的安装,简介如下: matplotlib是pyt...</span> </div> <!--end::Title--> </div> <!--begin::Item--> <div class="d-flex flex-stack mb-7"> <!--begin::Symbol--> <div class="symbol symbol-60px symbol-2by3 me-4"> <div class="symbol-label" style="background-image: url('/static/assets/images/nopic.gif')"></div> </div> <!--end::Symbol--> <!--begin::Title--> <div class="m-0"> <a href="/program/4837.html" class="text-dark fw-bold text-hover-primary fs-6">微信小程序使用slider实现...</a> <span class="text-gray-600 fw-semibold d-block pt-1 fs-7">众所周知哈,微信小程序里面的音频播放是没有进度条的,但最近有个项目呢,客户要求音频要有进度条控制,所...</span> </div> <!--end::Title--> </div> </div> <!--end::Body--> </div> <!--end::Chart Widget 35--> </div> <!--end::Col--> </div> </div> <!--end::Content container--> </div> <!--end::Content--> </div> <!--end::Content wrapper--> <!--begin::Footer--> <div id="kt_app_footer" class="app-footer"> <!--begin::Footer container--> <div class="app-container container-xxl d-flex flex-column flex-md-row flex-center flex-md-stack py-3"> <!--begin::Copyright--> <div class="text-dark order-2 order-md-1"> <span class="text-muted fw-semibold me-1">2026 ©</span> 晓说杂谈<script> var _hmt = _hmt || []; (function() { var hm = document.createElement("script"); hm.src = "https://hm.baidu.com/hm.js?f7b4581e1f9f88ac28d46df58a8d3ff5"; var s = document.getElementsByTagName("script")[0]; s.parentNode.insertBefore(hm, s); })(); </script> <a target="_blank" href="https://beian.miit.gov.cn/">豫ICP备13019747号-13</a> </div> <!--end::Copyright--> <!--begin::Menu--> <ul class="menu menu-gray-600 menu-hover-primary fw-semibold order-1"> <li class="menu-item"> <a href="/tech" target="_blank" class="menu-link px-2">科技分享</a> </li> <li class="menu-item"> <a href="/web" target="_blank" class="menu-link px-2">网络技术</a> </li> <li class="menu-item"> <a href="/hardware" target="_blank" class="menu-link px-2">硬件设备</a> </li> <li class="menu-item"> <a href="/program" target="_blank" class="menu-link px-2">程序人生</a> </li> <li class="menu-item"> <a href="/jinrong" target="_blank" class="menu-link px-2">探索发现</a> </li> <li class="menu-item"> <a href="/jixie" target="_blank" class="menu-link px-2">机械加工</a> </li> <li class="menu-item"> <a href="/dianshang" target="_blank" class="menu-link px-2">电商</a> </li> <li class="menu-item"> <a href="/other" target="_blank" class="menu-link px-2">其他</a> </li> <li class="menu-item"> <a href="/zhishi" target="_blank" class="menu-link px-2">日常知识</a> </li> <li class="menu-item"> <a href="/yulu" target="_blank" class="menu-link px-2">每日语录</a> </li> </ul> <!--end::Menu--> </div> <!--end::Footer container--> </div> <!--end::Footer--> </div> <!--end:::Main--> </div> <!--end::Wrapper--> </div> <!--end::Page--> </div> <!--end::App--> <div id="kt_scrolltop" class="scrolltop" data-kt-scrolltop="true"> <!--begin::Svg Icon | path: icons/duotune/arrows/arr066.svg--> <span class="svg-icon"> <svg width="24" height="24" viewBox="0 0 24 24" fill="none" xmlns="http://www.w3.org/2000/svg"> <rect opacity="0.5" x="13" y="6" width="13" height="2" rx="1" transform="rotate(90 13 6)" fill="currentColor"></rect> <path d="M12.5657 8.56569L16.75 12.75C17.1642 13.1642 17.8358 13.1642 18.25 12.75C18.6642 12.3358 18.6642 11.6642 18.25 11.25L12.7071 5.70711C12.3166 5.31658 11.6834 5.31658 11.2929 5.70711L5.75 11.25C5.33579 11.6642 5.33579 12.3358 5.75 12.75C6.16421 13.1642 6.83579 13.1642 7.25 12.75L11.4343 8.56569C11.7467 8.25327 12.2533 8.25327 12.5657 8.56569Z" fill="currentColor"></path> </svg> </span> <!--end::Svg Icon--> </div> <!--begin::Javascript--> <script>var hostUrl = "/static/default/pc/";</script> <!--begin::Global Javascript Bundle(mandatory for all pages)--> <script src="/static/default/pc/plugins/global/plugins.bundle.js"></script> <script src="/static/default/pc/js/scripts.bundle.js"></script> <!--end::Global Javascript Bundle--> <!--end::Javascript--> </body> <!--end::Body--> </html>