Python爬取京东的商品分类与链接

admin

2023-08-01 12:38:16

0次

前言

本文主要的知识点是使用Python的BeautifulSoup进行多层的遍历。

如图所示。只是一个简单的哈,不是爬取里面的隐藏的东西。

示例代码

from bs4 import BeautifulSoup as bs

import requests

headers = {

\"host\": \"www.jd.com\",

\"User-Agent\": \"Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/47.0.2526.80 Safari/537.36 Core/1.47.933.400 QQBrowser/9.4.8699.400\",

\"Accept\": \"text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,*/*;q=0.8\"

}

session = requests.session()

def get_url():

renspned = bs(session.get(\'http://www.jd.com/\',headers = headers).text,\'html.parser\')

for i in renspned.find(\"div\", {\"class\": \"dd-inner\"}).find_all(\"a\",{\"target\":\"_blank\"}):

print(i.get_text(),\':\',i.get(\'href\'))

get_url()

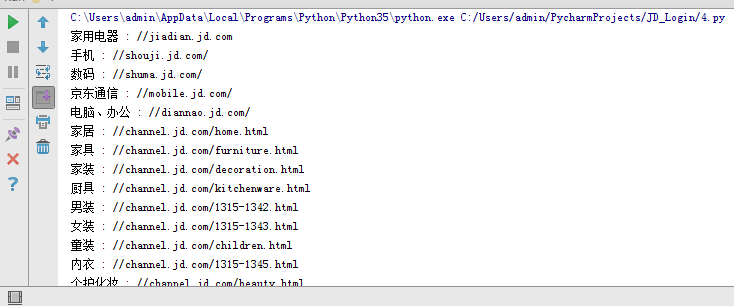

运行这段代码以及达到了我们的目的。

我们来解读一下这段代码。

首先我们要访问到京东的首页。

然后通过BeautifulSoup对访问到的首页进行解析。

这个时候,我们就要定位元素,来获取我们需要的东西了。

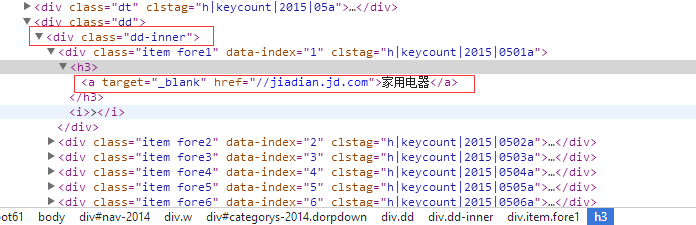

在浏览器中通过F12,我们可以看到下图所示的东西:

我们来看看下面这句代码:

for i in renspned.find(\"div\", {\"class\": \"dd-inner\"}).find_all(\"a\",{\"target\":\"_blank\"})

这一行代码完全满足我们的需求,首先用find方法,定位到了class=“dd-inner”的div,然后使用find_all对该标签下所有的a标签。

最后,我想打印出所有的商品分类以及对应的链接,于是,我使用了i.get_text()和i.get(\'href\')的方法终于获取到了商品分类和对应的链接。

总结

其实不是很难,主要是要用对方法。笔者因为是初学方法没有用对。花了差不多两天时间才搞定。这里也是告诉大家,可以使用find().find_all()的方法进行多层的遍历。以上就是我利用Python爬取京东的商品分类与链接的一些经验,希望对大家学习python能有所帮助。

相关内容

热门资讯

500 行 Python 代码...

语法分析器描述了一个句子的语法结构,用来帮助其他的应用进行推理。自然语言引入了很多意外的歧义,以我们...

定时清理删除C:\Progra...

C:\Program Files (x86)下面很多scoped_dir开头的文件夹 写个批处理 定...

65536是2的几次方 计算2...

65536是2的16次方:65536=2⁶

65536是256的2次方:65536=256

6553...

Mobi、epub格式电子书如...

在wps里全局设置里有一个文件关联,打开,勾选电子书文件选项就可以了。

scoped_dir32_70...

一台虚拟机C盘总是莫名奇妙的空间用完,导致很多软件没法再运行。经过仔细检查发现是C:\Program...

pycparser 是一个用...

`pycparser` 是一个用 Python 编写的 C 语言解析器。它可以用来解析 C 代码并构...

小程序支付时提示:appid和...

[Q]小程序支付时提示:appid和mch_id不匹配

[A]小程序和微信支付没有进行关联,访问“小...

Prometheus+Graf...

一,Prometheus概述

1,什么是Prometheus?Prometheus是最初在Sound...

python绘图库Matplo...

本文简单介绍了Python绘图库Matplotlib的安装,简介如下:

matplotlib是pyt...

微信小程序使用slider实现...

众所周知哈,微信小程序里面的音频播放是没有进度条的,但最近有个项目呢,客户要求音频要有进度条控制,所...